1 : 2026/05/08(金) 15:59:29.97 ID:Nr1Zh3oE0

2 : 2026/05/08(金) 15:59:41.98 ID:Nr1Zh3oE0

AIに最適

3 : 2026/05/08(金) 15:59:56.18 ID:Nr1Zh3oE0

Macより安い

4 : 2026/05/08(金) 16:00:59.02 ID:hnUR1IdAH

やっぱりwindowsがいいからこっちが欲しい

12 : 2026/05/08(金) 16:04:19.49 ID:Nr1Zh3oE0

>>4

AIに関してはLinux専用だぞ

AIに関してはLinux専用だぞ

15 : 2026/05/08(金) 16:06:39.10 ID:G/FwRr9P0

>>12

windowsのlm studioでgpt-oss-120bが使えてるよ。

windowsのlm studioでgpt-oss-120bが使えてるよ。

19 : 2026/05/08(金) 16:08:49.89 ID:tNzahNrPd

>>15

なんでblackwellにしなかったの?

なんでblackwellにしなかったの?

23 : 2026/05/08(金) 16:11:21.01 ID:Nr1Zh3oE0

>>19

1枚700万円😨

1枚700万円😨

5 : 2026/05/08(金) 16:01:14.87 ID:jfahL3ky0

CUDA積んでますか?

6 : 2026/05/08(金) 16:02:11.39 ID:jJ4DlX2f0

次買うならmacかな

7 : 2026/05/08(金) 16:02:14.12 ID:kV6yjiuV0

358Hで十分

8 : 2026/05/08(金) 16:02:27.55 ID:7104gOqL0

LLM特化のAIマシンだな

もちろんゲームにも強いが(APUなのに4060級)、さすがにゲーム目的で買うやつは少ない

もちろんゲームにも強いが(APUなのに4060級)、さすがにゲーム目的で買うやつは少ない

9 : 2026/05/08(金) 16:03:04.29 ID:O0MgwmP+M

いくらすんだよ

ローカルLLMはコスパ悪くなりすぎだろう

ローカルLLMはコスパ悪くなりすぎだろう

10 : 2026/05/08(金) 16:03:50.56 ID:qoxVuloS0

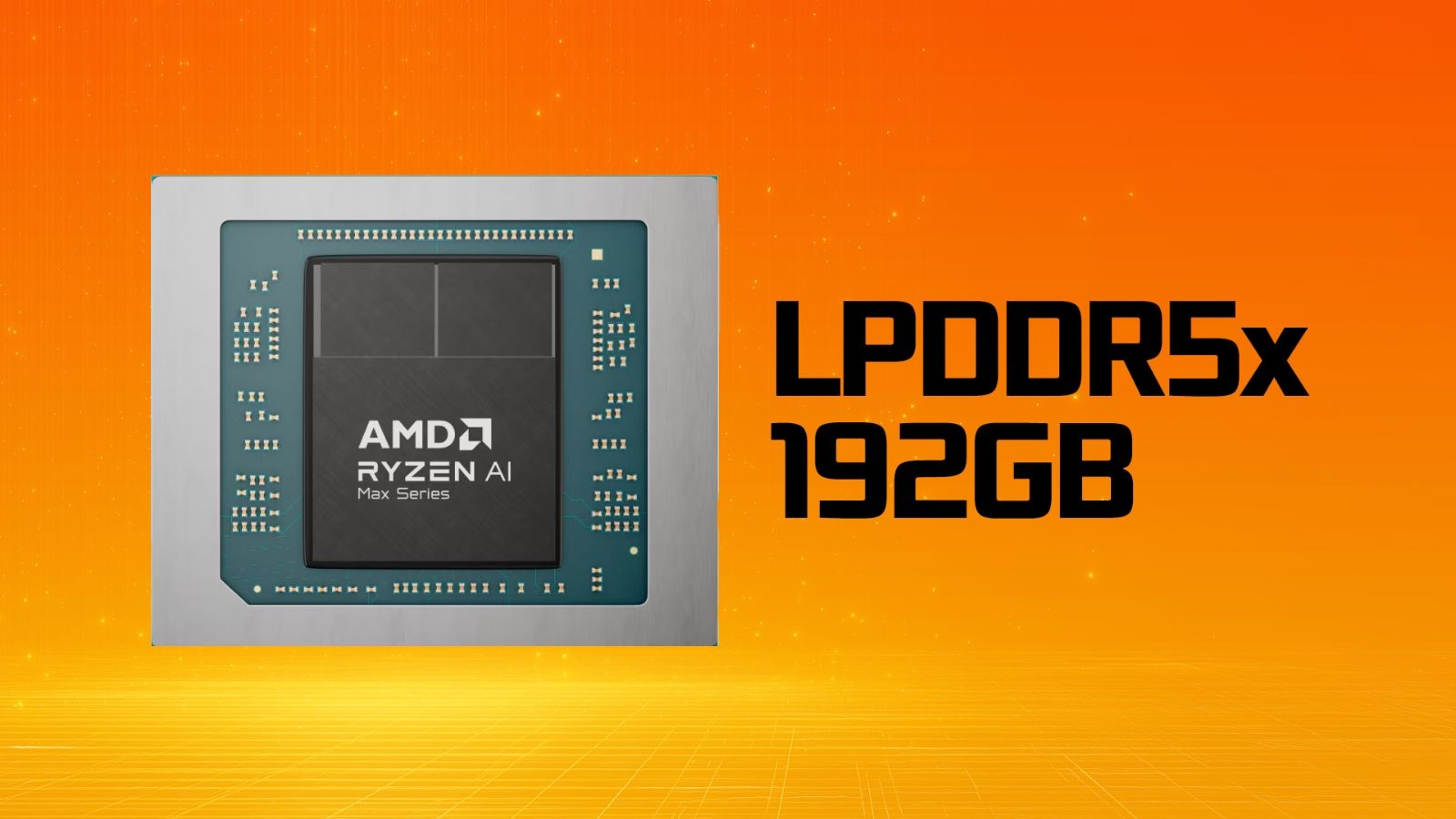

メモリ192GBに手が届く時代が来ると良いねえ

11 : 2026/05/08(金) 16:04:13.65 ID:G/FwRr9P0

俺はryzen ai max+ 395メモリ128GBを30万で買ったけど、今メモリ高いしどうなん?

13 : 2026/05/08(金) 16:04:34.01 ID:A/AlsmmP0

こういうのって新しい製造ラインを作ってるの?それとも選別品?

14 : 2026/05/08(金) 16:06:23.69 ID:HBYtqoR+0

ローカルLLM利用に特化したPCとして売れるだろうなぁ

(ヽ´ん`)「そこそこ有能レベルでいいからvibe codingを電気代だけで使いたいねん!」

というエンジニアに売れる

(ヽ´ん`)「そこそこ有能レベルでいいからvibe codingを電気代だけで使いたいねん!」

というエンジニアに売れる

codexを使うのが理想だけど金かかるからな…

16 : 2026/05/08(金) 16:07:36.68 ID:jK5jATzm0

>現行のRyzen AI MAX+ PRO 395搭載機はROG Flow Z13など一部モデルに限られ国内では40~60万円超の価格帯となっていますが、192GB構成のGorgon Haloはさらに上位価格となる見込みで、

解散!

17 : 2026/05/08(金) 16:07:40.53 ID:lGiClMKH0

メモリ買えねンだわ

18 : 2026/05/08(金) 16:08:36.57 ID:vAiEeIv+0

aiはもう飽きるまでサブスクした方が安いだろ

20 : 2026/05/08(金) 16:09:01.10 ID:7104gOqL0

嫌儲民は知らんだろうけど

使われるメモリがDDR5ではない

より高価で高速なLPDDR5なんだわ

だから余計に高くなる

使われるメモリがDDR5ではない

より高価で高速なLPDDR5なんだわ

だから余計に高くなる

21 : 2026/05/08(金) 16:09:23.78 ID:YD2kFeP40

nvidia以外はゴミ

22 : 2026/05/08(金) 16:09:59.22 ID:UFL0ywzr0

Cuda動くん?

24 : 2026/05/08(金) 16:12:10.11 ID:Nr1Zh3oE0

>>22

AIはMacが主流になったせいで昨今流行りのはCUDA依存はほぼない

AIはMacが主流になったせいで昨今流行りのはCUDA依存はほぼない

32 : 2026/05/08(金) 16:28:33.35 ID:O0MgwmP+M

>>24

推論だけならそうだけど

学習するならCUDAいるよ

推論だけならそうだけど

学習するならCUDAいるよ

25 : 2026/05/08(金) 16:12:50.53 ID:xqPP5UIU0

ローカルLLMって何に使うの?画像生成なら5090で良さそうだし

27 : 2026/05/08(金) 16:15:46.86 ID:hnUR1IdAH

>>25

その画像生成をエージェントが自律的にシナリオ書いたり画像作ったり検品したりできる

その画像生成をエージェントが自律的にシナリオ書いたり画像作ったり検品したりできる

28 : 2026/05/08(金) 16:16:32.54 ID:GKICcUsU0

Minisforumの現世代の128GBが今では60万の定価だからな

もっと高くなるぞ

もっと高くなるぞ

29 : 2026/05/08(金) 16:20:05.70 ID:G/pI/xu1d

ローカルLLMマシン用だな

30 : 2026/05/08(金) 16:21:48.95 ID:REco2No00

ローカルAI動画勢に朗報

31 : 2026/05/08(金) 16:23:24.55 ID:G/FwRr9P0

今マックスタジオでメモリ256GBやとおいくら万円?

もし買い替える時期が来たら検討するけどどうせマックは高すぎてシンドイ。

アイポンすらシンドイのに、マックスタジオしんどすぎてムリ。

もし買い替える時期が来たら検討するけどどうせマックは高すぎてシンドイ。

アイポンすらシンドイのに、マックスタジオしんどすぎてムリ。

34 : 2026/05/08(金) 16:31:46.27 ID:GKICcUsU0

>>31

256GBはもう買えないんじゃないの?

整備品を毎日確認すれば150万円くらいで買えるんじゃないかと

256GBはもう買えないんじゃないの?

整備品を毎日確認すれば150万円くらいで買えるんじゃないかと

33 : 2026/05/08(金) 16:30:14.65 ID:JH5of7TW0

これでメモリが安ければなー

コメント